苏州市干将路303号创意产业园

0512-3565 6563

Jackjones@kuaidata.com

联系客服

数据中心托管服务/管理式网络

服务:

400 651 8888

微软云服务:

400 089 2448

markjune@kuaidata.com

内容分布式网络服务:

400 811 0278

云集成与合作:

cloud@kuaidata.com

“AI大模型+人形机器人”的7大技术融合路径

2024-04-16

日前,优必选对外宣布与百度达成合作,将其人形机器人Walker S接入百度文心大模型,共探“AI大模型+人形机器人”创新应用,这也是国内首款接入大模型的人形机器人。在此之前Figure公司与OpenAI合作,发布了首个接入了OpenAI大模型的机器人demo——Figure 01,作为Figure和OpenAI合作的首批成果在业内引起不小的轰动,AI大模型+人形机器人正掀起下一波技术热潮。

那么,从技术角度来看,AI大模型和人形机器人在技术层面的结合到底有些可能性呢?

1.自然语言交互:

利用Transformer等注意力机制的神经网络架构,训练海量文本数据,构建强大的语言理解与生成模型。采用Seq2Seq、BERT、GPT等模型结构,实现高质量的语音识别(ASR)、自然语言理解(NLU)和自然语言生成(NLG)。在交互中引入Grounding技术,让机器人能根据实物环境信息更准确地理解用户意图。代表案例:Alexa、Siri等智能语音助手已广泛应用自然语言处理技术,能与用户进行流畅对话;Xiaomi CyberOne等人形机器人搭载大语言模型,实现高自然度语音交互。

2.知识库与推理:

通过Knowledge Embedding将结构化知识库如Freebase映射到连续向量空间,再利用Graph Neural Network等技术学习知识图谱表示,增强大模型的知识性和逻辑推理能力。在预训练阶段引入知识蒸馏和对比学习,让模型更好地吸收结构化知识。利用归纳逻辑编程(ILP)、Markov逻辑网等技术进行逻辑推理。代表案例:IBM Watson利用知识库实现强大的问答和逻辑推理能力;DeepMind的AlphaGo以知识驱动的方式掌握围棋知识,并用于对弈推理。

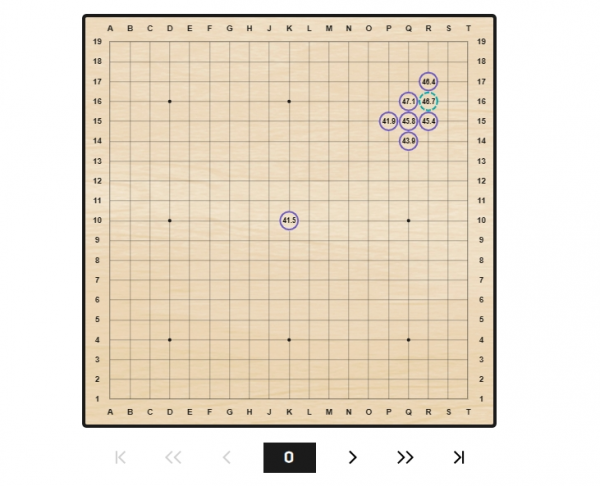

DeepMind的AlphaGo以知识驱动的方式掌握围棋知识

3.多模态感知与决策:

通过Multimodal Transformer、Cross-attention等技术融合视觉、语音、文本等多模态信息。利用主动学习让机器人主动询问未知环境信息,减少感知不确定性。将计算机视觉技术如目标检测、图像分割等与大模型相结合,实现场景理解。在决策中引入因果推理,增强机器人应对复杂环境的鲁棒性。代表案例:Elon Musk的Optimus机器人将深度学习应用于视觉感知,实现精准的目标识别与抓取;Robotic Vision公司将视觉信息融入语言模型,实现更全面的场景理解。

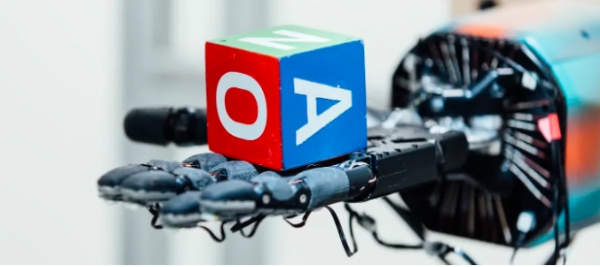

将视觉信息融入语言模型

4.运动规划:

采用深度强化学习(DRL)训练运动规划模型,如DDPG、SAC等,让机器人通过trial and error学习最优运动轨迹。将运动规划与Imitation Learning相结合,通过模仿人类动作,实现更自然的运动。利用Sim2Real技术弥合仿真与真实环境的差距。将运动规划与反馈控制结合,实现更稳定、实时的运动控制。代表案例:Boston Dynamics的Atlas机器人采用模仿学习与强化学习相结合,实现了高难度体操动作;Robotic AI公司利用深度强化学习实现机器人精准控制。

Robotic AI公司利用深度强化学习实现机器人精准控制

5.任务规划与执行:

通过Hierarchical Task Network等技术将复杂任务分解为多层次可执行子任务。利用Monte-Carlo Tree Search(MCTS)等算法在任务规划中进行全局优化搜索。在执行中采用Behavior Tree或有限状态机(FSM)等技术编排子任务,处理不同场景下的状态转移。同时引入错误监控和问题诊断技术,增强任务执行的容错性。代表案例:通用汽车(GM)的Dreamcatcher系统利用MCTS进行智能装配任务规划;NASA的Robonaut 2利用分层控制结构,自主执行空间站维修等任务。

Robonaut 2自主执行空间站维修等任务

6.情感交互:

利用多模态情感识别模型,融合面部表情、语音语调、身体动作等信息,实现用户情绪的准确理解。在情感生成中,采用GAN等生成式模型合成表情、动作。利用Seq2Seq模型生成情感回复。在对话中融入幽默、同理心等社交策略,让交互更具人性化。代表案例:Hanson Robotics的Sophia机器人通过面部表情合成和声音合成,实现了丰富的情感表达;Emoshape公司的情感芯片赋予机器人表达同理心的能力。

Emoshape公司的情感芯片赋予机器人表达同理心的能力

7.持续学习:

采用元学习(Meta-learning)让机器人学会如何学习,实现快速适应新任务、新环境的能力。通过Continual Few-Shot Learning、Incremental Learning等技术在少量新数据上进行增量学习,克服灾难性遗忘问题。引入主动学习,让机器人主动向用户询问未知知识,加速学习进程。代表案例:Cogitai公司利用增量学习技术,让智能体在连续学习中不断进化;Dactyl项目利用元学习,让机器人掌握多种物体操纵技能。

Dactyl项目利用元学习让机器人掌握多种物体操纵技能

以上技术的融合有望全面提升人形机器人在感知、认知、决策、规划、控制、交互、学习等方面的能力,最终实现更加智能化、人性化的人形机器人。但目前这一领域仍处于探索阶段,在算法、硬件、系统集成等方面仍面临不少挑战,离大规模商业化应用还有一定距离。